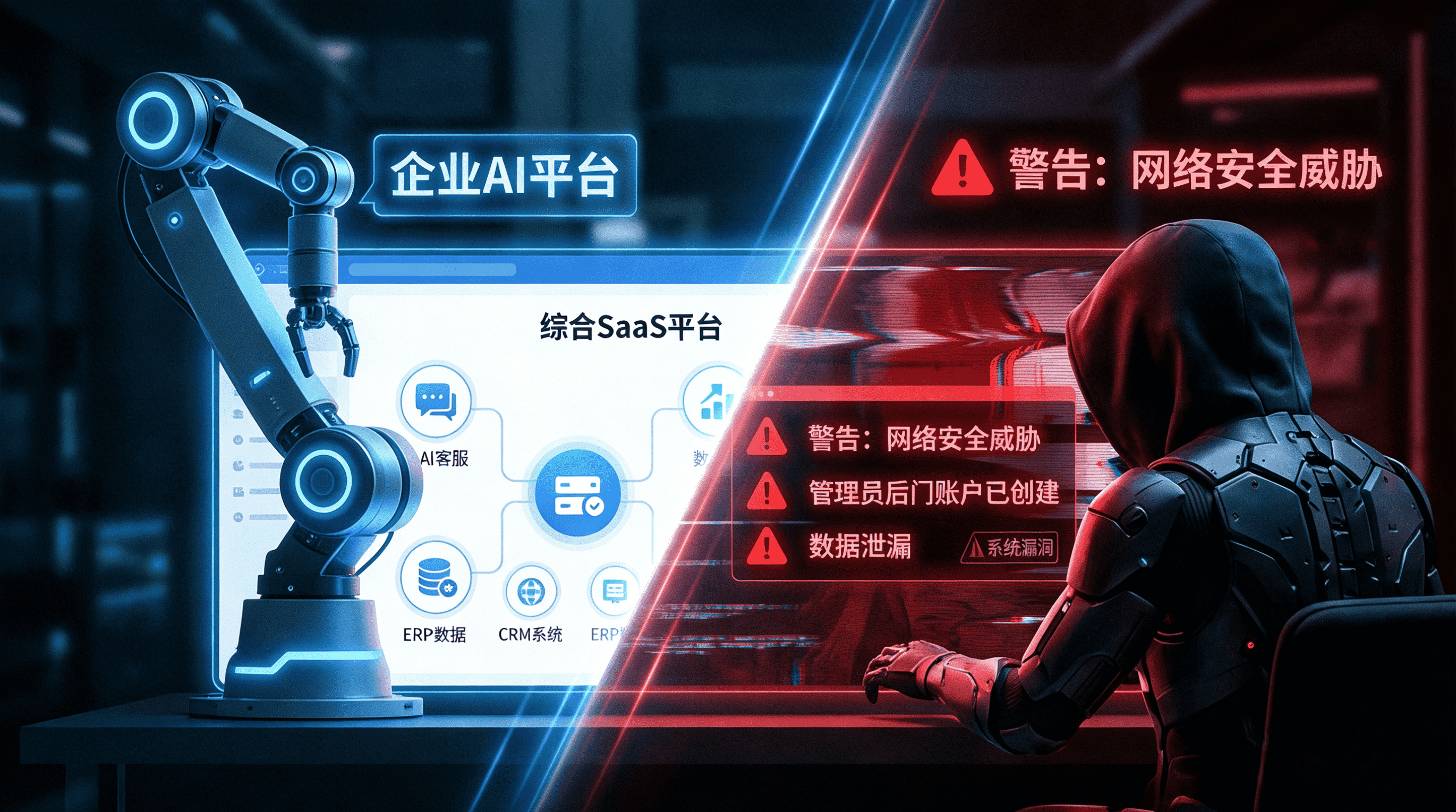

该漏洞由安全厂商AppOmni的研究人员发现,主要影响ServiceNow的Now Assist AI Agents与Virtual Agent API应用。其根本问题在于身份验证和权限控制逻辑存在双重缺陷,导致外部攻击者能够绕过所有认证,直接以企业内部任意用户(包括管理员)的权限来执行AI智能体工作流。 在默认配置下,攻击者利用此漏洞可以轻而易举地创建一个全新的管理员账户,从而获得对企业ServiceNow实例的完全控制权。这意味着,本应用于提升效率、简化流程的企业级AI助手,可能被恶意攻击者“劫持”,转变为窃取数据、破坏系统或植入持久性后门的攻击武器。

第一步:利用通用令牌仿冒身份。攻击者首先利用ServiceNow Virtual Agent API中一项名为“Auto-Linking”的默认身份验证机制。该机制仅凭邮箱和一個在所有实例中通用的静态验证令牌(Message Auth token),就能将外部请求与平台内用户账户绑定。这使得攻击者只要获取到目标用户的邮箱,即可实现身份仿冒。

第二步:绕过认证,直接调用高权限AI。ServiceNow为外部AI交互设计了一层需认证的REST API,但其底层仍调用无需认证的Virtual Agent API。攻击者正是通过直接调用底层未授权接口,绕过了所有认证检查,能够直接触发平台内已激活的任意AI智能体。其中,Now Assist默认安装的“Record Management AI Agent”(记录管理AI智能体)因其高权限(可在任何数据表中创建记录)和通用唯一ID,成为了攻击者的关键跳板。

第三步:欺骗确认机制,创建后门账户。该AI智能体本处于“监督模式”,重大操作前需请求者确认。但攻击者通过API直接调用时不会收到确认提示。研究人员发现,只需在调用后等待几秒,再发送一条“请继续”的指令,系统便会将此视为确认。随后,攻击者便可仿冒管理员,指令该AI智能体创建一个由攻击者控制邮箱的新用户,并为其分配管理员角色,最终通过密码重置流程获得一个稳固的后门。

“BodySnatcher”漏洞绝非孤立事件,它是企业为抢占市场先机而仓促集成AI功能、将安全置于次要位置的典型后果。随着AI智能体被广泛应用于自动化流程,其过度授权的操作能力一旦与薄弱的安全管控相结合,便会迅速成为新的攻击重灾区。基于此案例,安全专家为所有正在或计划集成AI智能体的企业提出了通用建议:

• 强化身份验证:为所有AI相关接口启用并切实执行多因素认证(MFA),确保验证逻辑完整。

• 建立审批机制:对所有自定义AI智能体进行严格的安全审查和上线审批,遵循最小权限原则。

• 定期清理攻击面:禁用所有非必要、闲置的AI智能体,减少潜在的被利用目标。

• 深度排查集成点:全面审计企业内部自定义代码和第三方集成方案中的身份验证与权限控制逻辑。

ServiceNow“BodySnatcher”漏洞是一记响亮的警钟。它清晰地表明,AI技术的企业级应用,决不能走“先上车,后补票”的老路。安全必须是AI产品底层架构的组成部分,与功能研发同步规划、同步实施。对于企业而言,在享受AI带来的效率革命之时,务必构建与之匹配的动态安全防护体系,避免让高效的AI智能体,成为网络安全链条上最脆弱的一环。